Wat is een LLM (Large Language Model)?

Een heldere uitleg over wat een LLM is, hoe Large Language Models leren en genereren, wat ze wel en niet kunnen, en het verschil met chatbots en agents.

De vraag ‘wat is een LLM’ komt vaker voor dan je denkt, ook van mensen die ChatGPT dagelijks gebruiken. Een LLM of Large Language Model is het model dat onder de motorkap zit wanneer je een chatbot een vraag stelt. In dit artikel leggen we uit wat een LLM is, hoe het leert, wat het kan, en waar de grenzen liggen — zonder wiskunde of academisch jargon.

We bekijken zes dingen: de korte definitie, hoe LLM’s getraind worden, wat tokens zijn, wat ze wel en niet kunnen, de bekendste voorbeelden, en het verschil tussen een LLM, een chatbot en een AI-agent.

Wat is een LLM in één zin?

Een Large Language Model is een machine learning-model dat getraind is op enorme hoeveelheden tekst en leert om het meest waarschijnlijke volgende woord te voorspellen, gegeven de tekst ervoor. Klinkt simpel. Schaal dat op naar miljarden parameters en het kan essays schrijven, code genereren, talen vertalen en vragen beantwoorden.

De term ‘large’ verwijst naar twee dimensies: de grootte van het model (honderden miljarden tot biljoenen parameters) en de hoeveelheid tekst waarop het getraind is (typisch honderden miljarden tot enkele biljoenen woorden). Die schaal is wat een LLM onderscheidt van kleinere taalmodellen uit de jaren 2010.

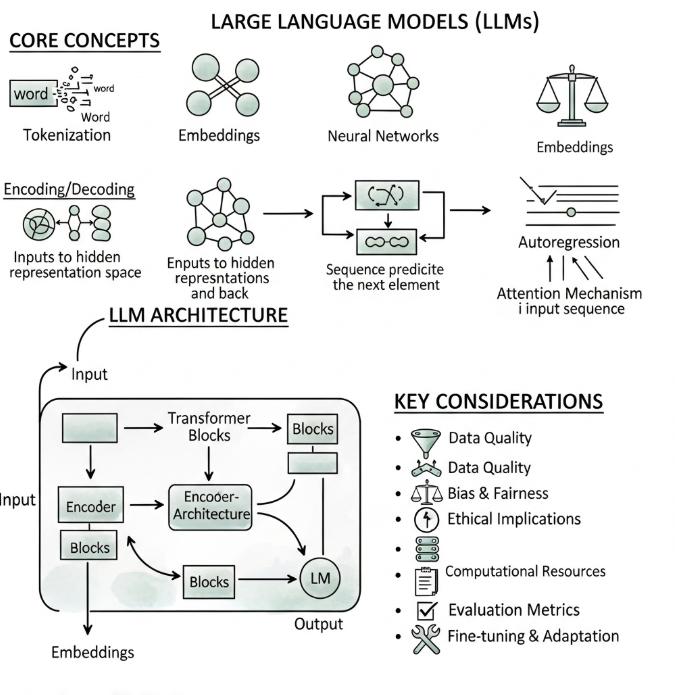

Hoe leert een LLM? De training in drie fasen

Een LLM wordt niet geprogrammeerd met feiten; hij leert patronen. De training verloopt typisch in drie opeenvolgende fasen.

1. Pretraining. Het model leest ruwe tekst — boeken, websites, wetenschappelijke artikels, forumdiscussies, code — en leert de statistische patronen van taal. Na deze fase kan het model coherente tekst afmaken, maar heeft het nog geen besef van wat ‘goede’ of ‘helpful’ output is in een gesprek.

2. Instructietuning. Het model wordt bijgeschoold op voorbeelden van instructies en correcte antwoorden. Nu leert het bijvoorbeeld dat “Vat dit artikel samen” een samenvatting verwacht, niet meer tekst in dezelfde stijl.

3. Menselijke feedback (RLHF). Menselijke beoordelaars rangschikken antwoorden, en het model leert te prefereren wat mensen als nuttig en correct beoordelen. Deze fase verklaart waarom moderne LLM’s beleefd, gestructureerd en meestal veilig antwoorden, zelfs bij dubbelzinnige prompts.

Het hele proces kost miljoenen euro’s aan rekenkracht voor de grootste modellen. OpenAI, Anthropic, Google en Meta zijn de bedrijven die dit vandaag op die schaal doen. Volgens het Stanford AI Index-rapport liggen de trainingskosten voor topmodellen inmiddels ruim boven de 100 miljoen dollar per model.

Wat is een token?

Een LLM leest geen woorden zoals wij. Hij leest tokens: stukjes tekst die het model als bouwsteen gebruikt. Een token kan een heel woord zijn (‘banaan’), een woordfragment (‘-tion’) of een spatie met letter. Vuistregel voor het Engels: 1 token ≈ 0,75 woord. Voor het Nederlands ligt dat iets lager door langere woordvormen.

Tokens zijn relevant omdat alles wat je in een LLM stopt in tokens wordt gerekend: je prompt, de context die het model bijhoudt, en de output die je terugkrijgt. De limieten van een model worden uitgedrukt in tokens (‘context window’): GPT-4o Turbo hanteert 128.000 tokens, Claude 4.7 inmiddels een miljoen. Dat bepaalt hoeveel je kan meegeven voor één vraag.

Het kostenmodel volgt ook de tokens: je betaalt per miljoen tokens input en per miljoen tokens output. Dat is waarom lange documenten en lange antwoorden je API-rekening snel kunnen laten stijgen.

Wat kan een LLM wel en niet?

Sterke punten: tekst genereren in elke stijl en elk register, samenvatten, vertalen, classificeren, vragen beantwoorden op basis van meegegeven context, code schrijven, bestaande tekst herstructureren. Kortom, alles waarbij taal zelf het medium is.

Zwakke punten:

- Hallucinaties. Het model verzint plausibel-klinkende onjuiste feiten, vooral bij niche-onderwerpen of recente gebeurtenissen.

- Geen actuele kennis. Zonder internetzoekopdracht kent het model alleen wat in de trainingsdata stond (vaak 6-12 maanden oud).

- Slecht in precieze wiskunde en logica. Rekent patroongewijs, niet procedureel. Voor rekenen gebruikt een moderne LLM vaak een externe tool (calculator, code-interpreter).

- Geen geheugen tussen sessies tenzij je dat expliciet inbouwt.

Deze grenzen kennen is de helft van goed gebruik. Wie bewust werkt rond hallucinaties (door context mee te geven, door cross-checks, door retrieval-augmented setups) haalt waarde. Wie blind vertrouwt, krijgt onvermijdelijk fouten door.

Voorbeelden: de bekendste LLM’s in 2026

De belangrijkste modellen in productie op dit moment:

- GPT-familie (OpenAI): GPT-4o en de o-serie. Sterk in brede consumententoepassingen, multimodaal, ChatGPT is de bekendste interface.

- Claude-familie (Anthropic): Claude Opus, Sonnet en Haiku. Uitblinker in lange documenten, nuance en code.

- Gemini-familie (Google): sterk verweven met Google’s zoek- en productecosysteem, actuele informatie via live web-toegang.

- Llama-familie (Meta): open-source, gratis te draaien op eigen infrastructuur, het middel bij uitstek voor wie data-controle belangrijk vindt.

Onze vergelijking tussen de drie commerciële grootmachten staat in ChatGPT vs Claude vs Gemini.

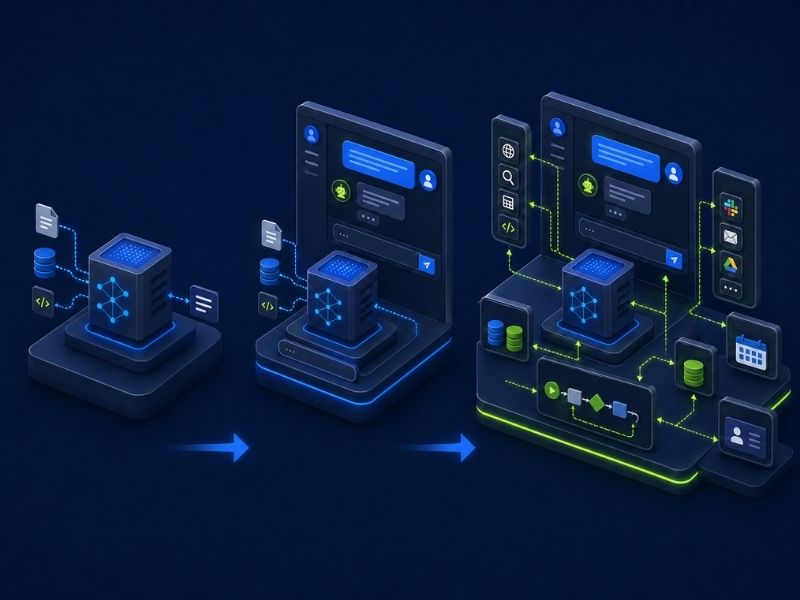

LLM versus chatbot versus agent: het verschil

Drie termen die vaak door elkaar gebruikt worden, maar verschillende dingen aanduiden:

- LLM: het ruwe model. Neemt tekst in, produceert tekst. Rauw en zonder interface.

- Chatbot: een LLM met een gespreksinterface, geheugen van het huidige gesprek, en meestal veiligheidsfilters. ChatGPT is de meest bekende.

- AI-agent: een LLM dat tools kan gebruiken (zoeken, API’s bevragen, bestanden lezen, code uitvoeren) en autonoom meerdere stappen kan uitvoeren om een doel te bereiken.

Je kiest welke abstractielaag je nodig hebt op basis van je use case. Voor een eenvoudige vraag-antwoord-flow volstaat een chatbot. Voor een proces dat automatisch meerdere systemen raadpleegt en acties uitvoert, heb je een agent nodig.

Wat betekent dit voor jouw AI-keuzes?

Drie praktische implicaties voor wie met AI aan de slag wil:

- Kies je model op basis van taak, niet van hype. Lange documenten? Claude. Web-informatie? Gemini. Breed en multimodaal? GPT. Data binnenshuis? Llama.

- Reken in tokens, niet in woorden. Je context-window en je kost schalen met tokens, niet met zinnen.

- Combineer met tools. Een puur LLM is krachtig; met RAG, zoekopdrachten en tooling wordt het een productiewerkpaard.

Voor de volgende laag van begrip raden we aan: hoe werkt ChatGPT achter de schermen en prompt engineering. Daar zie je hoe deze principes zich in de dagelijkse praktijk vertalen.

Samengevat

Een LLM is een machine-learningsysteem dat getraind is op massale hoeveelheden tekst om het meest waarschijnlijke volgende token te voorspellen. Uit die bouwsteen ontstaat tekstgeneratie in menselijke kwaliteit. De grenzen — hallucinaties, gebrek aan actuele kennis, beperkte rekenkundigheid — zijn reëel en worden in productie opgevangen door rond het model te bouwen: met context, tools en verificatielagen. Wie dit begrijpt, gebruikt AI scherper dan wie er blind in vertrouwt.