Wie controleert AI? Toezicht, transparantie en de mens in de loop

Wie is verantwoordelijk als AI een fout maakt? Dit artikel legt uit hoe toezicht op AI werkt in de praktijk, wat de EU AI Act verandert, en wat dat concreet betekent voor ondernemers die AI-tools inzetten.

Naarmate AI vaker beslissingen ondersteunt of uitvoert, rijst de vraag wie er verantwoordelijk is als het fout loopt. Wie controleert AI? Het antwoord is gelaagd: technisch, juridisch en organisatorisch. Dit artikel legt uit hoe toezicht op AI werkt in de praktijk, wat de EU AI Act verandert, en wat dat concreet betekent voor een ondernemer die AI-tools inzet.

Het korte antwoord: AI controleert zichzelf niet. Achter elk AI-systeem dat een beslissing neemt of een aanbeveling doet, staat menselijke verantwoordelijkheid — bij de ontwikkelaar, bij het bedrijf dat het inzet, of bij de medewerker die de output verwerkt. Het verschil zit in hoe die verantwoordelijkheid is georganiseerd.

De drie niveaus van menselijk toezicht

In de praktijk bestaan er drie modellen voor hoe mensen en AI samenwerken bij het nemen van beslissingen.

Volledig geautomatiseerd. Het AI-systeem neemt beslissingen zonder tussenkomst van een mens. Voorbeeld: een spamfilter die e-mails automatisch blokkeert. Dit werkt goed voor lage-risico, repetitieve taken waar de kost van een fout beperkt is en het volume te hoog is voor handmatige controle.

Human-in-the-loop. Een mens valideert elke beslissing voordat die wordt uitgevoerd. Het AI-systeem doet een voorstel; de mens beslist. Dit is het juiste model voor consequente beslissingen — kredietverlening, medische diagnoses, juridische adviezen. De AI verhoogt de efficiëntie en consistentie, maar de eindverantwoordelijkheid blijft bij de mens.

Human-on-the-loop. Het AI-systeem werkt autonoom maar wordt gemonitord. Een mens kan ingrijpen als de output buiten verwachte parameters valt. Dit is het meest gebruikte model voor bedrijfsprocessen zoals e-mailclassificatie, contentgeneratie of klantenservice-chatbots. Periodieke evaluatie vervangt continue goedkeuring.

De keuze voor het juiste model hangt af van het risiconiveau van de toepassing. Voor een chatbot die FAQ-vragen beantwoordt, volstaat human-on-the-loop. Voor een systeem dat kredietbeslissingen beïnvloedt, is human-in-the-loop een minimusvereiste.

Wie is verantwoordelijk als AI een fout maakt?

Aansprakelijkheid bij AI-fouten is een juridisch domein in ontwikkeling. Vandaag geldt als basisprincipe: de organisatie die een AI-systeem inzet, is verantwoordelijk voor de uitkomsten. Dat geldt ook als de organisatie de tool heeft gekocht bij een externe aanbieder.

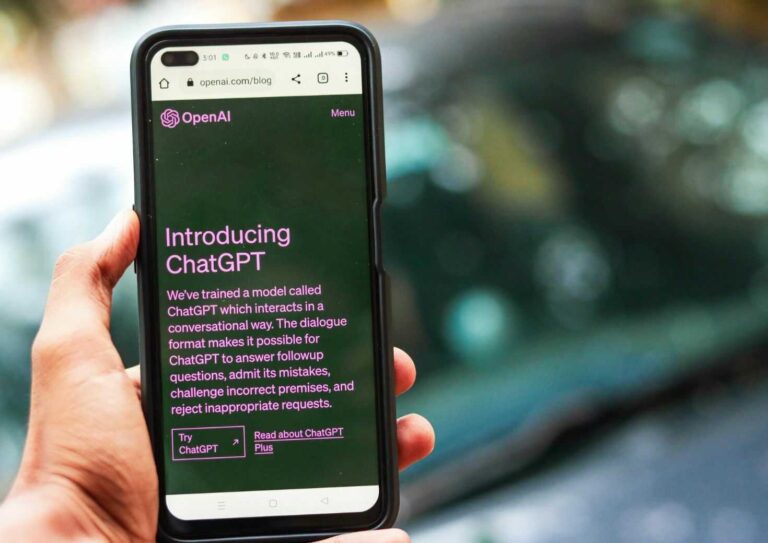

Dat betekent concreet: als jij een AI-tool gebruikt die een foutieve aanbeveling doet aan een klant, en je vertrouwt die aanbeveling zonder check, dan rust de aansprakelijkheid bij jou — niet bij OpenAI of een andere modelleverancier. De modelaanbieder is verantwoordelijk voor het functioneren van het model; de gebruiker is verantwoordelijk voor de inzet ervan.

Dit is geen theoretische kwestie. In sectoren als financiën, gezondheidszorg en juridische dienstverlening zijn er al procedures geweest waarbij bedrijven aansprakelijk werden gesteld voor beslissingen waarbij AI betrokken was. Het draait om de vraag of er voldoende menselijk toezicht was — en of dat toezicht aantoonbaar was.

Wat de EU AI Act verandert voor toezicht

De EU AI Act, van kracht vanaf 2024 en gefaseerd in werking tredend tot 2027, introduceert verplichte toezichtsmechanismen voor AI-systemen op basis van risiconiveau.

Voor hoog-risico AI-systemen — systemen die beslissingen nemen in onderwijs, werkgelegenheid, kredietverlening, rechtshandhaving of gezondheidszorg — zijn menselijk toezicht en transparantie verplicht. Aanbieders en gebruikers van zulke systemen moeten aantonen dat een mens de systeembeslissingen kan begrijpen, aanvechten en overschrijven.

Voor laag-risico toepassingen — chatbots, contentgeneratie, aanbevelingssystemen zonder juridische gevolgen — gelden geen verplichte toezichtseisen. Wel is er een transparantieverplichting: gebruikers moeten weten dat ze met AI interageren.

Voor de meeste KMO’s die AI inzetten voor administratieve taken, marketing of klantenservice vallen de toepassingen in de lage-risico categorie. Dat neemt niet weg dat goede praktijken — periodieke evaluatie, duidelijke escalatieregels, en documentatie van wat je AI-tool doet — altijd verstandig zijn.

Transparantie: wat betekent uitlegbaarheid van AI?

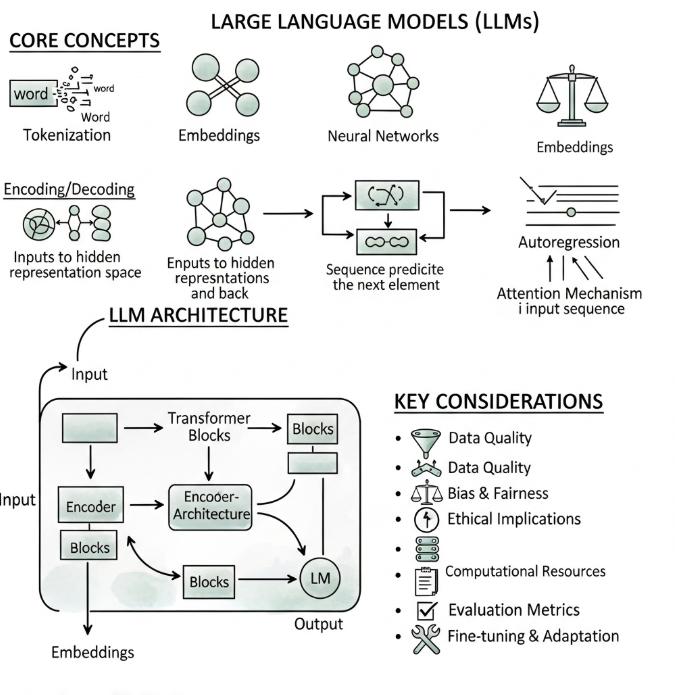

Een kerneis voor toezicht op AI is uitlegbaarheid: het vermogen om te verklaren waarom een AI-systeem een bepaalde output heeft gegenereerd. Dat is technisch gezien een uitdaging — grote taalmodellen als ChatGPT zijn zogenaamde “black boxes”, waarbij de interne werking niet transparant is, zelfs niet voor de ontwikkelaars.

In de praktijk betekent uitlegbaarheid voor een bedrijf niet dat je de technische werking van een model moet kennen. Het betekent dat je kunt verantwoorden welke input je het systeem geeft, welke output het genereert, en hoe je die output gebruikt. Die traceerbaarheid is beheersbaar met goede procesafspraken en documentatie — ook voor kleine bedrijven.

Een chatbot die klanten te woord staat, hoeft niet uit te leggen hoe het neurale netwerk werkt. Maar je moet wel kunnen aantonen dat je periodiek controleert wat die chatbot zegt, hoe je escalaties afhandelt, en hoe je klachten over foutieve AI-output verwerkt.

Praktische toezichtsstrategie voor KMO’s

Menselijk toezicht op AI hoeft niet complex te zijn om effectief te zijn. Voor de meeste KMO’s volstaan vier basismaatregelen.

Definieer escalatieregels. Welke beslissingen mag de AI autonoom nemen, en wanneer moet een mens betrokken worden? Schrijf dit op. Niet voor een compliance-audit, maar omdat het je dwingt na te denken over de grenzen van je automatisering.

Monitor de output periodiek. Check maandelijks een steekproef van wat je AI-systemen genereren of beslissen. Zoek naar patronen in fouten, inconsistenties of onverwachte outputs. Dat is geen bureaucratische oefening — het is kwaliteitscontrole.

Maak AI-gebruik transparant naar klanten. Als klanten interageren met een chatbot, moeten ze dat weten. Dat is niet alleen een ethische keuze — het is een wettelijke verplichting onder de EU AI Act voor de meeste geautomatiseerde klantinteracties.

Documenteer je AI-tools en hun gebruik. Een korte beschrijving van welke AI-tools je gebruikt, waarvoor, en hoe je de output controleert, is de basis van een verdedigbare AI-governance voor een kleine organisatie.

Voor meer context over hoe AI technisch werkt en hoe dat de controlekwestie beïnvloedt: Hoe werkt AI? Simpel uitgelegd voor beginners. En voor de overkoepelende strategie: de AI-gids voor Belgische ondernemers.