De AI-stack uitgelegd: van chip tot applicatie

Wat zit er achter AI-tools? De AI-stack van GPU-hardware tot applicatie in zes lagen uitgelegd, met praktische inzichten voor betere technologiebeslissingen.

De AI-stack — het geheel van lagen waaruit een AI-systeem is opgebouwd, van hardware tot gebruikerstoepassing — is voor veel ondernemers een zwarte doos. Je gebruikt ChatGPT of een AI-marketing tool, maar wat zit er eigenlijk achter? Dit artikel legt de stack uit van onderaf: chips, trainingsinfrastructuur, modellen, platforms en applicaties. Niet voor de curiositeit maar omdat een basisinzicht in de stack je helpt betere technologiebeslissingen te nemen.

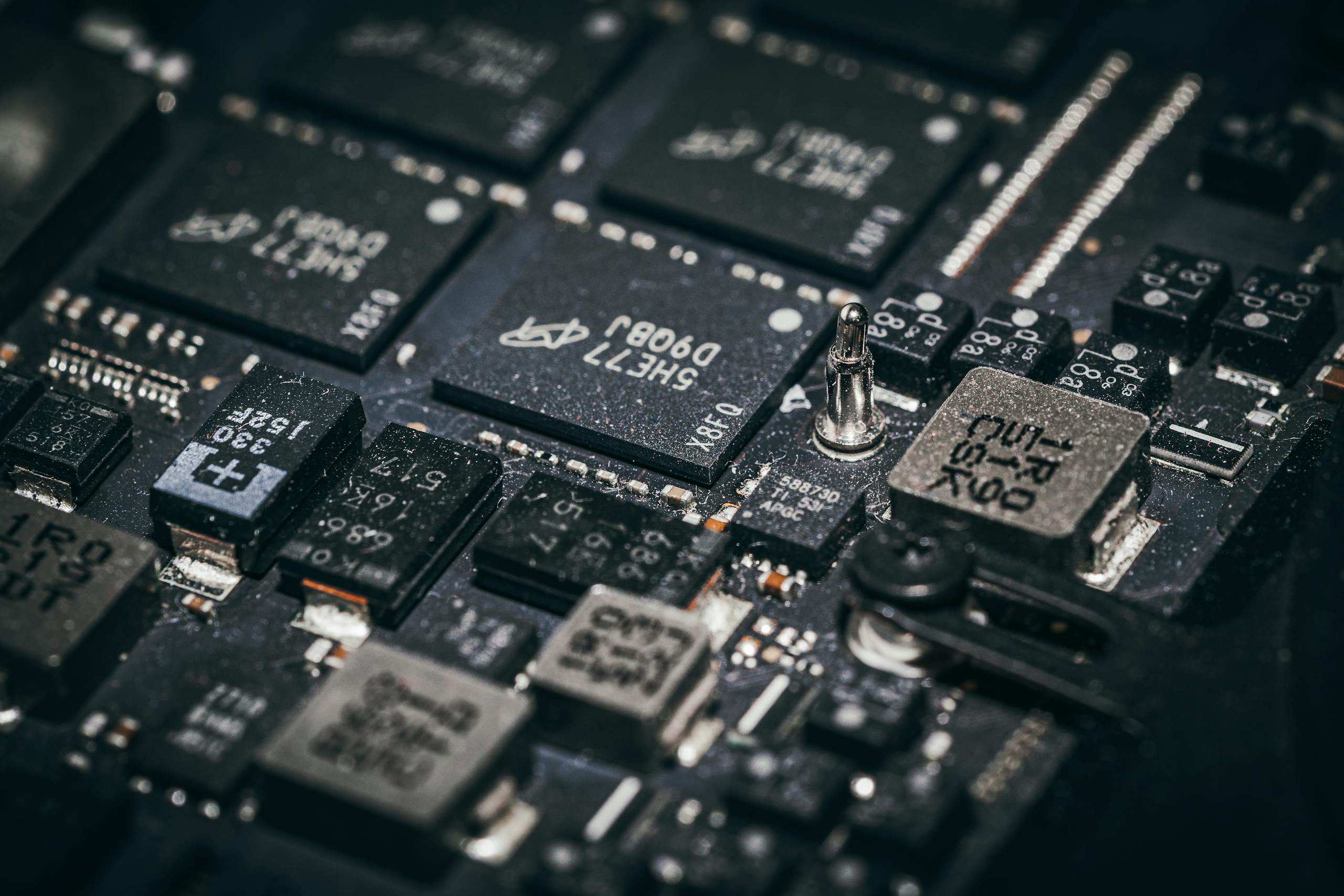

Laag 1: hardware — de GPU als fundament

Elke AI-applicatie die je gebruikt, draait uiteindelijk op hardware — en in het bijzonder op GPU’s (Graphics Processing Units). GPU’s zijn niet gebouwd voor AI maar bleken ideaal: ze kunnen massale parallelle berekeningen uitvoeren, wat exact is wat het trainen van een neuraal netwerk vereist.

De dominante speler: NVIDIA met zijn A100 en H100 data-center GPU’s. Een enkele H100 kost €25.000-35.000; een trainingsrun voor een groot model gebruikt duizenden van deze chips gedurende weken tot maanden. De schaarste en kosten van GPU’s verklaren waarom slechts een handvol bedrijven (OpenAI, Google, Anthropic, Meta) top-modellen kunnen trainen: de instapdrempel is een miljardenbedrag aan hardware alleen al.

Voor een KMO is dit irrelevant om zelf te bezitten — je leent rekenkracht via de cloud (AWS, Azure, Google Cloud, die allemaal GPU-clusters verhuren per uur).

Laag 2: trainingsinfrastructuur

Boven de hardware zit de trainingsinfrastructuur: de software-frameworks, orchestratie en dataopslag die nodig zijn om een model te trainen. Bekende frameworks: PyTorch (dominant voor research en productie) en TensorFlow (Google, minder dominant geworden). Distributed training tools zoals DeepSpeed en Megatron-LM zorgen dat trainingsloads over duizenden GPU’s kunnen worden verdeeld.

Cloudproviders bieden kant-en-klare trainingsomgevingen (Google Vertex AI, AWS SageMaker, Azure ML). Fine-tuning — het aanpassen van een bestaand model op je eigen data — is technisch haalbaar voor bedrijven met een technisch team en voldoende gelabelde data. Pre-training van scratch is voor KMO’s geen optie.

Laag 3: foundation models

De modellen zelf vormen de derde laag. Foundation models zijn grote, breed getrainde modellen die als basis dienen voor vrijwel alle AI-applicaties die je gebruikt. De bekendste:

- GPT-4o / o3 (OpenAI) — marktleider, breed inzetbaar, goede tool-use en reasoning.

- Claude 3.7 / 4 (Anthropic) — sterk in lange context, nuanceteksten en instructieopvolging.

- Gemini 1.5 / 2.0 (Google) — sterkst voor multimodale taken en Google-ecosysteem-integraties.

- Llama 3 (Meta) — open-source, zelf te hosten, ideaal voor privacygevoelige toepassingen.

Het model dat jij via een applicatie bereikt, is vrijwel altijd een versie van één van deze foundation models — soms met fine-tuning of een extra instructielaag erop.

Laag 4: inference-infrastructuur en API’s

Een getraind model moet real-time antwoorden genereren op gebruikersvragen — dat heet inference. Inference vereist andere hardware-optimalisaties dan training en wordt door de modelaanbieders als API aangeboden. Je stuurt een tekstverzoek (prompt), het model genereert een antwoord, jij ontvangt het.

Prijsmodel: per token (stuk tekst). Prijzen variëren van €0,0002 tot €0,015 per 1.000 tokens afhankelijk van het model. Voor typisch KMO-gebruik (honderden tot duizenden prompts per maand) zijn de kosten zelden een bottleneck — eerder de setup-tijd en integratie.

Aanbieders van inference-API’s naast de modelontwikkelaars zelf: OpenRouter (aggregator voor meerdere modellen), Groq (ultralage latency), Together.ai (open-source modellen op schaal).

Laag 5: platforms en middleware

Tussen de ruwe API en de eindgebruiker zit een platformlaag: tools die de API inpakken in bruikbare functies. LangChain en LlamaIndex zijn de bekendste middleware-frameworks voor ontwikkelaars. Make.com en n8n zijn de no-code equivalenten voor business-gebruikers.

Vector databases (Pinecone, Qdrant, Weaviate) horen ook in deze laag: ze slaan tekst op als wiskundige vectoren en maken snelle semantische zoekopdrachten mogelijk — de basis voor RAG-systemen (Retrieval Augmented Generation) die AI koppelen aan jouw specifieke kennisbasis.

Laag 6: applicaties — wat je dagelijks gebruikt

De bovenste laag is wat je als eindgebruiker kent: ChatGPT, Claude.ai, Copilot, Notion AI, GoHighLevel AI, Midjourney, Synthesia. Al deze applicaties zijn gebouwd bovenop één of meerdere foundation models via de API-laag, met een gebruikersinterface en specifieke instructie-logica erop.

De applicatielaag is waar de concurrentie het heftigst is: het model zelf is voor veel bedrijven vergelijkbaar geworden, het onderscheid zit in de interface, de workflow-integratie en de specifieke instructie-tuning voor een use case.

Wat betekent dit voor jouw technologiebeslissingen?

Drie praktische inzichten die het stack-begrip geeft:

- Vendor-diversificatie op applicatielaag is laag risico. Migreren van ChatGPT naar Claude of vice versa is relatief makkelijk — de onderliggende data is jouw data. Vastzetten aan één applicatie-leverancier is minder gevaarlijk dan vastzetten aan één databasis.

- RAG is goedkoper dan fine-tuning voor de meeste use cases. Je hoeft geen model te trainen om het op jouw kennisbasis te laten werken. RAG koppelt jouw documenten als context aan de bestaande API — technisch eenvoudiger en onderhoudsvriendelijker.

- Open-source modellen zijn een serieuze optie voor privacygevoelige data. Llama 3 op een eigen server verwerkt data zonder die naar externe providers te sturen. Aanzienlijk complexer te beheren maar relevant voor gereguleerde sectoren.

Voor de AI-trends die de stack in 2026 beïnvloeden: AI trends 2026 voor bedrijven. Voor het uitleggen van AI-concepten aan je team: hoe werkt AI, simpel uitgelegd.

Samengevat

De AI-stack loopt van GPU-hardware via trainingsinfrastructuur, foundation models en inference-API’s, middleware en platforms naar de applicaties die je dagelijks gebruikt. Een KMO hoeft geen stack-engineer te zijn maar profiteert van het basisinzicht: kies tools op de applicatielaag met exportmogelijkheden, gebruik RAG boven fine-tuning voor kennisbasisintegratie, en overweeg open-source modellen wanneer data-privacyvereisten dat rechtvaardigen. Het stack-begrip maakt je een betere afnemer van AI-diensten.